一场关乎人工智能未来发展的关键承诺在全球科技界引发广泛关注。OpenAI、微软、智谱AI等来自全球的16家领先人工智能公司共同签署了一项具有里程碑意义的《前沿人工智能安全承诺》。这一行动不仅标志着产业界对AI安全治理的共识达到新高度,更预示着人工智能基础软件的开发将步入一个更负责任、更透明、更可控的新阶段。

一、承诺的核心:将安全置于前沿AI发展的中心

此次签署的承诺文件聚焦于“前沿人工智能模型”——即那些能力最强、影响最深远的下一代AI系统。各公司郑重承诺,将在基础软件的开发过程中,将安全作为核心优先事项。这并非空泛的口号,而是包含了一系列具体、可验证的承诺:

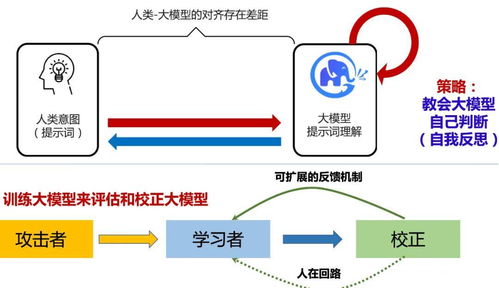

- 安全优先的开发框架:承诺在模型训练、部署和更新的全生命周期内,系统性地评估和管理风险,包括防止模型被滥用、确保其与人类价值观对齐、以及控制其潜在的社会影响。

- 严格的内部测试与外部审查:在模型公开发布或大规模应用前,必须通过严格的内外部安全评估。这包括邀请独立第三方专家进行“红队测试”,主动寻找系统的漏洞、偏见和有害输出。

- 投资安全研究:共同承诺投入可观资源,用于推进AI安全领域的研究,特别是在模型可解释性、稳健性、内容审核和价值观对齐等方面,旨在构建更强大的安全技术护栏。

- 透明的风险信息披露:承诺以清晰、易懂的方式,向用户、合作伙伴及公众披露其前沿AI模型的能力、局限性和已知风险,建立负责任的透明度。

- 协作与信息共享:建立一个跨公司的协作机制,共享关于AI安全威胁、最佳实践和缓解措施的信息,形成集体防御能力,共同应对最严峻的挑战。

二、为何聚焦“人工智能基础软件开发”?

承诺特别强调“基础软件开发”,这抓住了AI安全问题的根源。基础模型(如大语言模型、多模态模型)是当今AI应用的“操作系统”和“引擎”。其安全性直接决定了上层无数应用生态的安危。如果在底层模型中存在安全缺陷或价值观偏差,那么在其上构建的所有应用都可能被放大风险。

因此,在基础软件层面筑牢安全基石,意味着:

- 从源头治理:在模型设计之初就嵌入安全考量,而非事后修补,效率更高,成本更低。

- 标准化推动:领先公司的共同承诺,有望催生行业通行的安全开发标准和测试基准,提升整体产业水位。

- 生态信任建立:为开发者、企业和最终用户使用和信赖AI技术提供了更坚实的基础,促进创新应用的繁荣。

三、签署方阵容:体现全球产业共识

此次签署方阵容强大且具有代表性,包括:

- 美国代表:OpenAI(ChatGPT创造者)、微软(主要投资者和云服务伙伴)、Anthropic(Claude开发商)、Google DeepMind等。

- 中国代表:智谱AI(GLM系列模型开发者)等,体现了中国顶尖AI公司在安全治理上与全球同步的积极姿态。

- 其他地区领先者:涵盖了北美、欧洲、亚洲等多个关键市场的创新公司。

这种跨越地域和竞争格局的联合,表明“安全发展”已成为超越商业竞争的行业共同底线和紧迫需求。尤其是在AI技术加速演进、能力边界不断突破的当下,这种自律性的承诺是对社会关切的积极回应,也是避免未来可能出现的严苛外部监管的先发行动。

四、挑战与未来展望

尽管承诺意义重大,但将其转化为扎实的行动仍面临挑战:如何平衡安全要求与创新速度?如何确保评估标准的客观性与一致性?如何让更多中小型开发者也遵循这些原则?

这一承诺可能成为AI治理史上的一个分水岭:

- 催化政策与法规:为各国政府制定AI相关法律和监管框架提供了宝贵的行业输入和合作基础。

- 重塑竞争维度:AI领域的竞争将不仅仅是模型规模和性能的比拼,更是安全性、可靠性和责任感的较量。

- 引导投资方向:资本和市场将更加青睐那些在安全治理上表现卓越的公司和项目。

###

OpenAI、微软、智谱AI等16家公司的联合承诺,是人工智能产业走向成熟的重要标志。它传递出一个明确信号:开发最强大AI的领导者们,正主动承担起确保这项变革性技术造福全人类的共同责任。将安全深度融入人工智能基础软件的开发基因,不仅是防范风险的必要之举,更是开启一个可持续、可信赖的AI新时代的关键钥匙。全球科技界此番携手,为AI的安全未来奠定了第一块坚实的基石,其后续执行与演化,值得全世界持续关注与期待。